成果|张小志课题组及合作者提出一种多模态医学影像融合新方案

近期,南华大学电气工程学院张小志课题组及合作者提出了一种联合Swin Transformer和多尺度卷积神经网络的无监督深度神经网络,用于多模态医学影像的融合。相关研究成果以“MRSCFusion: Joint Residual Swin Transformer and Multiscale CNN for Unsupervised Multimodal Medical Image Fusion”为题,在国际权威期刊《IEEE Transactions on Instrumentation and Measurement》上发表。

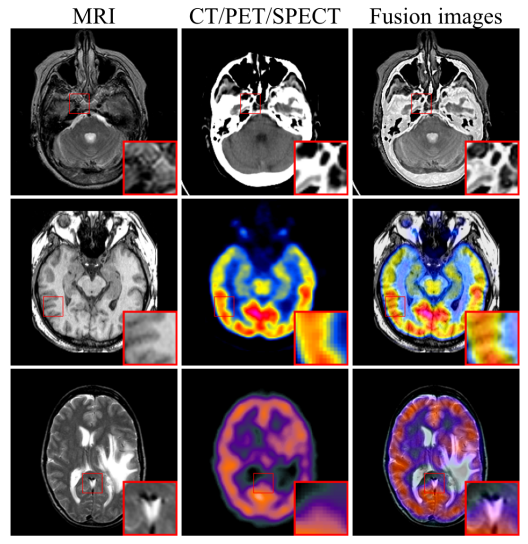

医学影像是临床诊断的重要手段,由于解剖结构影像和功能影像的成像原理不同,单模态医学影像的信息存在着局限性。通过图像融合技术将不同模态的医学影像融合在一起,实现不同模态间互补信息和突显优势,增强影像信息量,有助于更准确诊断和有效治疗。

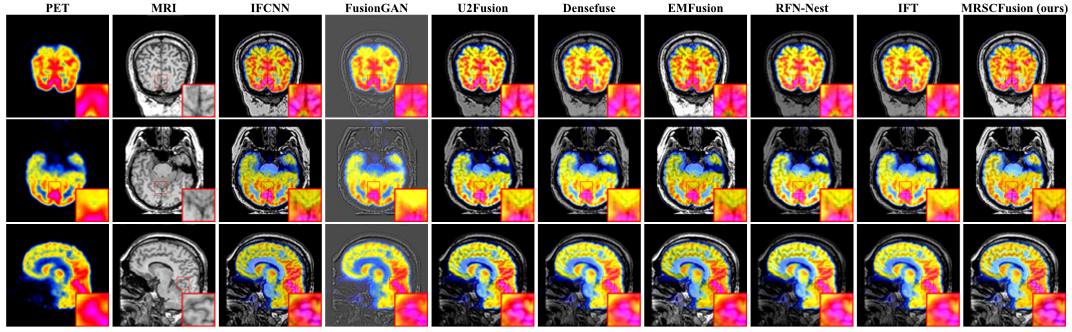

基于卷积神经网络的深度学习方法因其强大的建模能力而被应用于图像融合,但其感受野的局部性限制了融合性能的提升。为解决这个问题,张小志课题组提出一种全新的无监督多模态医学影像融合框架,设计了一个联合Swin Transformer和卷积神经网络模块对多尺度医学影像特征进行融合,该模块由一个用于捕获全局上下文信息的残差Swin Transformer分支和一个用于捕获局部细粒度信息的卷积神经网络分支组成。

此外,为进一步有效地保留医学影像的纹理特征和强度信息,定义了包含内容损失和强度损失的联合损失函数来约束融合模块,并引入自适应权重来控制源图像的信息保留程度。所提出的框架在CT-MRI、PET-MRI和SPECT-MRI等多个融合任务上进行实验,通过定性和定量分析验证了模型的优越性。

南华大学电气工程学院硕士生谢欣宇为第一作者,张小志副教授为通讯作者。其他合作者包括南华大学电气工程学院、计算机学院和南华大学附属第一医院的科研人员。上述研究工作得到国家自然科学基金面上项目(62071213,61871210)的资助。论文链接:https://ieeexplore.ieee.org/document/10256252